W ciągu ostatnich lat ChatGPT zdobył ogromną popularność – od pisania esejów po generowanie kodu. Coraz więcej zadań programistycznych można zautomatyzować właśnie z pomocą ChatGPT, co istotnie zmienia sposób pracy developerów. Szczególnie programiści Pythona – początkujący i średnio zaawansowani – mogą wiele zyskać, traktując ChatGPT jako wirtualnego asystenta do kodowania. Odpowiednio sformułowane prompty ChatGPT potrafią zmienić ogólnego chatbota w wyspecjalizowanego pomocnika programisty, zdolnego do debugowania kodu, generowania gotowych fragmentów i nawet pisania dokumentacji technicznej. W tym artykule pokażemy jak używać ChatGPT w programowaniu Python na konkretnych przykładach, obejmujących:

Automatyzację zadań (skrypty, CLI)

Analizę danych i wizualizacje (pandas, NumPy, Matplotlib)

Uczenie maszynowe (scikit-learn, TensorFlow)

Tworzenie backendu i API (Flask, FastAPI)

Debugowanie i refaktoryzację kodu Python

Każda sekcja zawiera przykładowy prompt (polecenie dla ChatGPT), wygenerowany kod w Pythonie oraz krótkie wyjaśnienie, jak ewentualnie poprawić lub rozbudować taki prompt, by uzyskać jeszcze lepsze rezultaty. Pamiętaj, że jasno określone instrukcje i kontekst zwykle przekładają się na bardziej precyzyjne odpowiedzi AI. Traktuj ChatGPT jak partnera do kodu – udostępniaj mu fragmenty kodu, opisuj dokładnie problem i zadawaj pytania uzupełniające. Taki styl pracy pozwala uzyskać najbardziej użyteczne wyniki. Zaczynajmy!

Automatyzacja zadań w Pythonie za pomocą ChatGPT

Jednym z pierwszych zastosowań, jakie przychodzi do głowy programistom Pythona, jest automatyzacja powtarzalnych zadań. ChatGPT może pomóc wygenerować skrypty automatyzujące pracę – od parsowania plików tekstowych, przez operacje na plikach CSV, po proste zadania w terminalu (CLI). Dzięki dobrze przygotowanemu promptowi, ChatGPT dla programistów Pythona potrafi szybko wygenerować kod oszczędzający czas. Na przykład, jak używać ChatGPT do automatyzacji w Pythonie? Rozważmy zadanie scalania wielu plików tekstowych w jeden plik CSV. Zamiast pisać taki skrypt od zera, możemy poprosić ChatGPT o jego wygenerowanie.

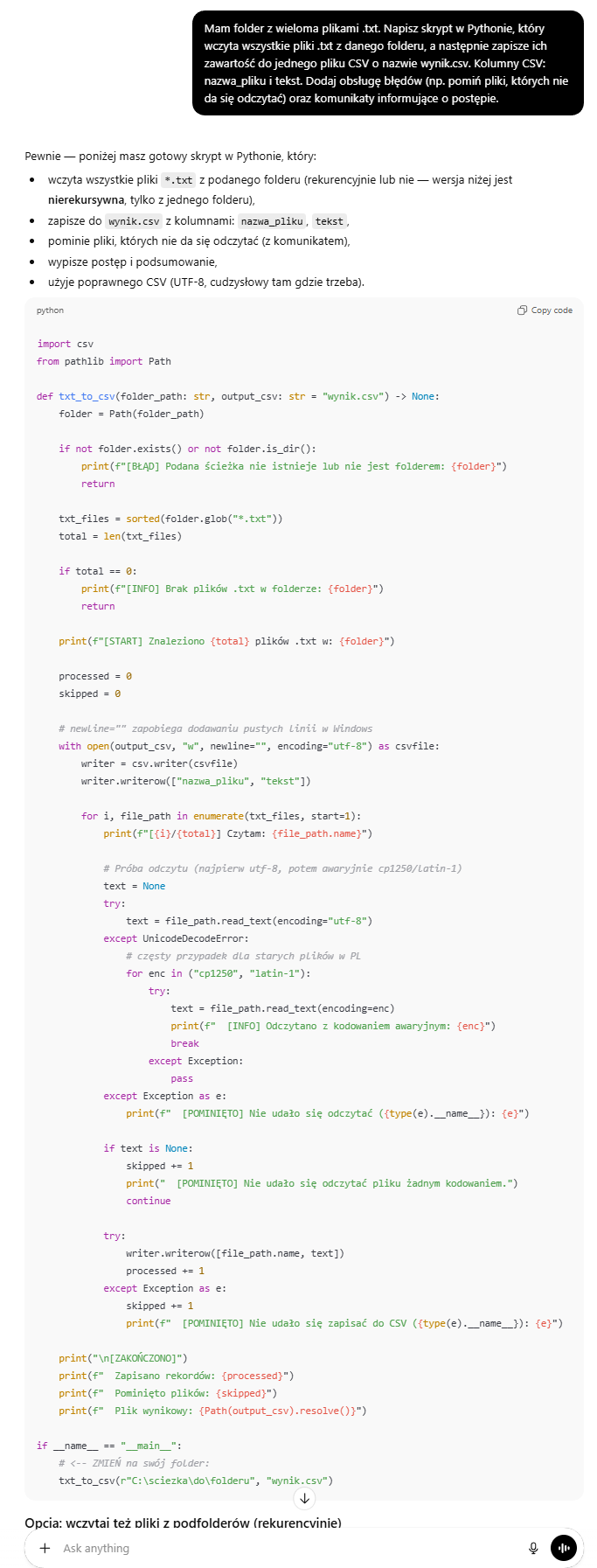

Przykładowy prompt (automatyzacja plików): „Mam folder z wieloma plikami .txt. Napisz skrypt w Pythonie, który wczyta wszystkie pliki .txt z danego folderu, a następnie zapisze ich zawartość do jednego pliku CSV o nazwie wynik.csv. Kolumny CSV: nazwa_pliku i tekst. Dodaj obsługę błędów (np. pomiń pliki, których nie da się odczytać) oraz komunikaty informujące o postępie.”

Wyjaśnienie promptu: Powyższe polecenie precyzuje język (Python), zadanie (scalenie plików tekstowych do CSV), format wyjściowy (plik CSV z określonymi kolumnami) oraz dodatkowe wymagania (obsługa błędów, komunikaty). Dzięki temu ChatGPT ma jasny obraz, co ma zrobić – taki kontekst i szczegóły znacznie zwiększają szansę na poprawny kod.

Przykład odpowiedzi ChatGPT (skrypt automatyzujący):

Wygenerowany skrypt korzysta z modułu glob do znalezienia wszystkich plików .txt w folderze oraz modułu csv do zapisu danych w formacie CSV. ChatGPT uwzględnił również obsługę błędów poprzez blok try/except – zgodnie z prośbą w promptcie. Dodał nawet proste logowanie postępów za pomocą print().

Jak ulepszyć ten prompt? Jeśli potrzebujemy dalszych usprawnień, możemy zadać pytanie uzupełniające lub zmodyfikować polecenie. Przykładowo, można poprosić: „Dodaj do skryptu opcję uruchamiania z linii poleceń z parametrem folderu wejściowego i nazwą pliku wyjściowego.” – w odpowiedzi ChatGPT prawdopodobnie przerobi skrypt, używając modułu argparse do obsługi argumentów CLI. Innym pomysłem jest doprecyzowanie, by skrypt ignorował duże pliki lub usuwał z tekstu znaki specjalne – wystarczy ująć takie wymagania w prompt. Im bardziej szczegółowo opiszemy oczekiwane zachowanie, tym bardziej dopasowany kod otrzymamy od ChatGPT. Pamiętajmy też, że możemy iteracyjnie współpracować z ChatGPT – po otrzymaniu pierwszej wersji kodu śmiało dopytujmy lub prośmy o poprawki, by osiągnąć pożądany efekt.

Analiza danych i wizualizacja (Data Science) z ChatGPT

Python dominuje w dziedzinie analizy danych i data science, więc nic dziwnego, że ChatGPT dla programistów Python jest świetnym wsparciem przy zadaniach związanych z danymi. Biblioteki takie jak pandas, NumPy czy Matplotlib często pojawiają się w kodzie generowanym przez ChatGPT, gdy prosimy go o pomoc w analizie lub wizualizacji. ChatGPT może sugerować kroki analizy eksploracyjnej, generować zapytania SQL, a przede wszystkim pisać kod do przetwarzania danych. Zobaczmy to na przykładzie: załóżmy, że mamy plik CSV z danymi sprzedaży i chcemy szybko policzyć sumy sprzedaży w poszczególnych kategoriach oraz zobrazować to na wykresie.

Przykładowy prompt (analiza danych): „Mam plik dane.csv zawierający kolumny: category (kategoria produktu) i value (sprzedaż w zł). Napisz kod w Pythonie (użyj biblioteki pandas), który wczyta ten plik, obliczy łączną wartość sprzedaży dla każdej kategorii, a następnie wygeneruje wykres słupkowy (Matplotlib) prezentujący te sumy. Dodaj etykiety osi i tytuł wykresu.”

💡 Wyjaśnienie promptu: Podajemy ChatGPT szczegółowy kontekst: nazwa pliku i kolumn, oczekiwane obliczenia (sumy po kategoriach) oraz format wyniku (wykres słupkowy z opisanymi osiami). Taki precyzyjny opis zadania pozwala modelowi jednoznacznie zrozumieć, czego potrzebujemy – czyli kodu łączącego pandas i Matplotlib w konkretnym celu.

Przykład odpowiedzi ChatGPT (analiza danych z wizualizacją):

import pandas as pd

import matplotlib.pyplot as plt

# Wczytanie danych z pliku CSV

df = pd.read_csv('dane.csv')

# Obliczenie sumy wartości dla każdej kategorii

suma_sprzedazy = df.groupby('category')['value'].sum().reset_index()

print(suma_sprzedazy) # Podgląd tabeli z sumami (opcjonalnie)

# Przygotowanie wykresu słupkowego

plt.figure(figsize=(6,4))

plt.bar(suma_sprzedazy['category'], suma_sprzedazy['value'], color='skyblue')

plt.xlabel('Kategoria')

plt.ylabel('Łączna sprzedaż')

plt.title('Łączna sprzedaż w każdej kategorii')

plt.tight_layout()

plt.show()

Wygenerowany kod wykorzystuje pandas do wczytania danych i zgrupowania ich po kolumnie category, obliczając sumy sprzedaży. Następnie za pomocą matplotlib tworzy wykres słupkowy z odpowiednio opisanymi osiami i tytułem. Taki kod stanowi gotowe rozwiązanie zadania analitycznego – wystarczy podstawić własną nazwę pliku i uruchomić.

Jak ulepszyć ten prompt? W zależności od potrzeb, możemy dalej precyzować polecenie. Jeśli ChatGPT pominął jakiś krok, np. wizualizację trendu w czasie albo zapis wykresu do pliku, możemy dodać to do prośby: „Zapisz wykres do pliku PNG” lub „Użyj Seaborn do uczynienia wykresu bardziej estetycznym”. Możemy też poprosić o analizę wyników: „Wygeneruj też krótką interpretację: która kategoria sprzedaje najwięcej i o ile przewyższa inne?”.

ChatGPT jest w stanie nie tylko wygenerować kod, ale i dostarczyć opis wniosków, co bywa bardzo pomocne dla data scientistów. Co ważne, gdy prosimy o kompleksowe zadanie (kod + wyjaśnienia), warto jasno zaznaczyć oczekiwany format odpowiedzi, np. „podaj kod i osobno omów wyniki”. Dzięki temu unikniemy zgadywania i otrzymamy dokładnie to, czego potrzebujemy.

Warto wspomnieć, że istnieją wręcz gotowe prompty ChatGPT do data science i ML – np. polecenia zaczynające się od „Jesteś doświadczonym data scientistem, pomóż mi…” mogą skutkować bardzo zaawansowanymi odpowiedziami. Jednak nawet dla mniej formalnych poleceń, ChatGPT zwykle radzi sobie z kodem pandas/NumPy. Pamiętajmy tylko, że model operuje na tekście – jeśli analiza wymaga faktycznego przetworzenia dużego zbioru danych, ChatGPT może zaproponować kod, ale go realnie nie wykona na naszych danych. Wygenerowany skrypt trzeba więc uruchomić samodzielnie w środowisku Pythona i zweryfikować wyniki.

Uczenie maszynowe (ML) z ChatGPT – od modelu po tuning

ChatGPT potrafi znacząco przyspieszyć tworzenie prototypów w obszarze machine learning. Dla początkujących jest to jak posiadanie mentora pod ręką – możemy zapytać o wyjaśnienie koncepcji ML, poprosić o napisanie kodu modelu, a nawet wygenerować przykładowe dane treningowe. Oczywiście, wygenerowany kod ML wymaga zrozumienia i oceny ze strony programisty, ale jako punkt wyjścia bywa niezastąpiony. Zobaczmy przykład: chcemy zbudować prosty model regresyjny przewidujący jakąś wartość na podstawie cechy numerycznej.

Przykładowy prompt (model ML): „Mam zbiór danych samochody.csv z kolumnami: horsepower (moc silnika) i speed (prędkość maksymalna). Zbuduj model uczenia maszynowego do przewidywania prędkości na podstawie mocy. Proszę o kod w Pythonie z wykorzystaniem scikit-learn, który: 1) wczyta dane, 2) podzieli je na zbiory treningowy i testowy, 3) nauczy model regresji liniowej, 4) wypisze błąd średniokwadratowy (MSE) na zbiorze testowym.”

Wyjaśnienie promptu: W tym poleceniu jasno określamy zadanie ML (regresja), biblioteki (

scikit-learn), konkretne kroki (podział danych, trening modelu, ewaluacja) oraz metrykę do wyświetlenia (MSE). Tak zorganizowany prompt prowadzi model przez całą sekwencję czynności, jak mini-plan, co zwykle skutkuje kompletnym przykładem kodu ML.

Przykład odpowiedzi ChatGPT (uczenie maszynowe):

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error

# Wczytanie danych

df = pd.read_csv('samochody.csv') # zakładamy kolumny: horsepower, speed

# Przygotowanie zmiennych X (cechy) i y (etykieta)

X = df[['horsepower']]

y = df['speed']

# Podział na zbiór treningowy i testowy

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Trenowanie modelu regresji liniowej

model = LinearRegression()

model.fit(X_train, y_train)

# Predykcja na zbiorze testowym

y_pred = model.predict(X_test)

# Obliczenie metryki błędu (MSE)

mse = mean_squared_error(y_test, y_pred)

print("Mean Squared Error:", mse)

Wygenerowany kod jest typowym szablonem trenowania modelu LinearRegression z biblioteki scikit-learn. Zawiera wszystkie kroki: wczytanie danych do DataFrame pandas, podział na trening/test (train_test_split), naukę modelu LinearRegression() oraz ewaluację za pomocą MSE. Taki kod możemy od razu uruchomić (pod warunkiem że posiadamy plik CSV z danymi w odpowiednim formacie) – ChatGPT zadbał o rozsądne domyślne wartości, jak test_size=0.2 i random_state dla powtarzalności wyników.

Jak ulepszyć ten prompt? Możliwości rozszerzenia są liczne. Gdy mamy już działający model, można poprosić ChatGPT o kolejne usprawnienia, np.:

„Dodaj wyświetlanie współczynników regresji i interpretację, co oznaczają.” – ChatGPT prawdopodobnie doda wypisanie model.coef_ i model.intercept_ wraz z opisem znaczenia tych wartości.

„Zastosuj ten sam kod do modelu lasu losowego (RandomForestRegressor) i porównaj MSE.” – dostaniemy kod z dodatkowym modelem ensemble i porównaniem wyników.

„Przeprowadź strojenie hiperparametrów za pomocą GridSearchCV dla modelu regresji.” – model może wygenerować blok kodu wykorzystujący GridSearchCV lub RandomizedSearchCV dla np. parametru fit_intercept czy innych. Istnieją gotowe prompty do takich zadań, np. „Mam model X, napisz kod do tuningowania hiperparametrów” – ChatGPT doskonale radzi sobie z takimi poleceniami.

Ponadto ChatGPT może pomóc wyjaśnić działanie modelu ML. Jeśli nie rozumiemy, czemu model daje takie predykcje, możemy zapytać: „Wyjaśnij, jak ten model liniowy podejmuje decyzje, czy funkcja jest liniowa względem cechy horsepower?”. Otrzymamy zapewne opis konceptu regresji liniowej. Możemy też iść krok dalej: „Mam wytrenowany model XGBoost – podaj kod w Pythonie, który wyjaśni predykcje za pomocą wartości SHAP.” – i model może zaproponować użycie biblioteki SHAP do interpretacji. Krótko mówiąc, ChatGPT potrafi wspierać programistów w całym workflow data science/ML: od czyszczenia danych, przez budowę modelu, po jego ocenę i interpretację.

Oczywiście, trzeba pamiętać, że ChatGPT nie zawsze wybierze optymalny model czy najlepsze parametry – to wciąż leży w gestii programisty. Jednak jako asystent do generowania przykładowego kodu czy prototypowania rozwiązań, spisuje się znakomicie. Z jego pomocą początkujący mogą szybciej zobaczyć wyniki swojego modelu, a bardziej doświadczeni – wygenerować szkielet, który następnie dostosują do swoich potrzeb.

Tworzenie backendu i API w Pythonie z pomocą ChatGPT

Kolejnym praktycznym zastosowaniem ChatGPT dla programistów jest szybkie tworzenie zarysów aplikacji backendowych i API. Jeśli pracujesz nad prostym API w Pythonie (np. REST API) lub prototypujesz backend, ChatGPT może wygenerować dla Ciebie boilerplate kod, oszczędzając czas na sprawach konfiguracyjnych. Wystarczy opisać, czego potrzebujesz – czy to endpoint w Flasku, czy całą strukturę CRUD w FastAPI – a model spróbuje dostarczyć działający przykład. Zademonstrujmy to na przykładzie z Flaskiem.

Przykładowy prompt (API Flask): „Napisz prostą aplikację Flask (Python), która udostępnia REST API do zarządzania listą zadań (to-do). Aplikacja powinna mieć dwa endpointy: GET /tasks (zwraca listę zadań w formacie JSON) oraz POST /tasks (dodaje nowe zadanie, które jest przesyłane w zapytaniu jako JSON). Użyj prostego magazynu danych w postaci listy Python (nie bazy danych). Zaimplementuj także podstawową walidację danych wejściowych i obsługę błędów (np. brak pola name w zadaniu).”

Wyjaśnienie promptu: Tutaj opisujemy konkretną mini-aplikację: język Python, framework Flask, charakter API (lista zadań, metody GET i POST), format danych (JSON) oraz dodatkowe wymagania (walidacja, obsługa błędów). Taki poziom szczegółowości to właściwie opis specyfikacji endpointów – ChatGPT na jego podstawie wygeneruje kod, który spełnia wyszczególnione kryteria.

Przykład odpowiedzi ChatGPT (minimalne API w Flasku):

from flask import Flask, request, jsonify

app = Flask(__name__)

tasks = [] # Lista przechowująca zadania

@app.route('/tasks', methods=['GET'])

def get_tasks():

# Zwracamy całą listę zadań w formacie JSON

return jsonify(tasks), 200

@app.route('/tasks', methods=['POST'])

def add_task():

if not request.is_json:

return jsonify({"error": "Request must be JSON"}), 400

data = request.get_json()

# Walidacja danych wejściowych

if 'name' not in data or not data['name']:

return jsonify({"error": "Task must have a 'name'"}), 400

# Tworzenie nowego zadania

new_task = {

"id": len(tasks) + 1,

"name": data['name']

}

tasks.append(new_task)

return jsonify(new_task), 201

if __name__ == '__main__':

app.run(debug=True)

Ten kod definiuje aplikację Flask z dwiema trasami: GET /tasks oraz POST /tasks. Wykorzystuje globalną listę tasks do przechowywania zadań w trakcie działania aplikacji (co jest oczywiście uproszczonym podejściem, ale zgodnym z treścią promptu). ChatGPT zadbał o walidację – sprawdza, czy żądanie ma JSON oraz czy przekazano pole name dla nowego zadania.

Obsługiwane są odpowiednie status kody HTTP (200 dla sukcesu GET, 201 dla stworzenia nowego zasobu, 400 dla błędnych żądań). To całkiem solidny start aplikacji RESTowej, wygenerowany w kilka sekund!

Jak ulepszyć ten prompt? W zależności od potrzeb projektu, możemy prosić ChatGPT o dalszą rozbudowę. Kilka pomysłów:

„Dodaj endpoint DELETE /tasks/<id> usuwający zadanie o podanym ID.” – model powinien dopisać obsługę usuwania, łącznie z walidacją czy ID istnieje.

„Przepisz ten kod na użycie frameworka FastAPI zamiast Flask.” – ChatGPT potrafi przełożyć rozwiązanie na inny framework, dodając np. deklaracje modeli Pydantic dla FastAPI.

„Dodaj w aplikacji prostą dokumentację (endpoint /docs lub opis w README) jak korzystać z API.” – możemy uzyskać tekst opisujący endpointy lub nawet wygenerowany markdown dokumentacji.

„Jak zabezpieczyć to API hasłem? Dodaj prostą autoryzację (np. token w nagłówku).” – model prawdopodobnie zmodyfikuje kod, dodając sprawdzanie nagłówka przy każdym żądaniu.

Należy wspomnieć, że ChatGPT może wygenerować nawet rozbudowane struktury backendu, jeśli go o to poprosimy. Istnieją prompty ChatGPT tworzące cały CRUD – np. „Wygeneruj pełen kod CRUD dla zasobu X w frameworku Y” spowoduje, że model dostarczy kontrolery, modele i trasy dla tworzenia/odczytu/aktualizacji/usuwania zasobu. Oczywiście, im większe wymagania, tym większa szansa, że kod będzie dłuższy lub nieco schematyczny. Dlatego warto podzielić prośby na mniejsze kroki (np. najpierw wygeneruj podstawę aplikacji, potem iteracyjnie dodawaj funkcje).

Tak czy inaczej, ChatGPT bywa niezastąpiony przy prototypowaniu API. Nawet jeśli nie użyjemy wygenerowanego kodu w produkcji, to jako szablon lub podstawa do dyskusji sprawdza się świetnie. Dla początkujących programistów to także cenna pomoc edukacyjna – na podstawie wygenerowanego kodu można uczyć się, jak mniej więcej powinna wyglądać struktura aplikacji webowej w Pythonie.

Debugowanie i refaktoryzacja kodu Python z ChatGPT

Wykrywanie błędów w kodzie oraz jego ulepszanie to chleb powszedni developerów. Również w tych zadaniach ChatGPT okazuje się niezwykle pomocny. Model językowy świetnie radzi sobie z analizą błędów i sugestią poprawek, o ile dostarczymy mu odpowiedni kontekst. Kluczem jest precyzyjne opisanie problemu: zamiast pytać ogólnie „Czemu mój kod nie działa?”, należy pokazać fragment kodu, komunikat błędu i oczekiwane działanie. Przy refaktoryzacji zaś – jasno określić, co chcemy poprawić (czy wydajność, czy czytelność, czy zgodność z dobrymi praktykami). Zademonstrujmy możliwości ChatGPT w scenariuszu debugowania.

Załóżmy, że piszemy funkcję obliczającą medianę listy liczb. Prosty kod może wyglądać tak:

def median(numbers):

sorted_nums = sorted(numbers)

mid = len(sorted_nums) // 2

return sorted_nums[mid]

Na pierwszy rzut oka wydaje się poprawny, ale szybko zauważymy, że dla list o parzystej liczbie elementów zwraca on tylko jeden ze środkowych elementów, zamiast średniej dwóch. Chcemy, by ChatGPT pomógł nam zidentyfikować ten błąd i zaproponował poprawkę.

Przykładowy prompt (debugowanie funkcji mediany): _„Poniższa funkcja w Pythonie jest przeznaczona do liczenia mediany listy liczb, ale dla list o parzystej długości daje niepoprawny wynik. Znajdź błąd i zaproponuj poprawioną wersję funkcji. Kod funkcji:

def median(numbers):

sorted_nums = sorted(numbers)

mid = len(sorted_nums) // 2

return sorted_nums[mid]

```”_

> 💡 **Wyjaśnienie promptu:** Tutaj dostarczamy **maksimum kontekstu**: mamy fragment kodu, opis problemu (niepoprawny wynik dla parzystej liczby elementów) i prosimy konkretnie o znalezienie błędu oraz poprawienie funkcji. Dzięki temu ChatGPT nie musi zgadywać – jasno wie, czego oczekujemy (diagnozy + poprawki).

**Przykład odpowiedzi ChatGPT (znalezienie bugu i poprawka):**

```python

def median(numbers):

sorted_nums = sorted(numbers)

n = len(sorted_nums)

mid = n // 2

if n % 2 == 0:

# Jeśli liczba elementów jest parzysta, medianą jest średnia dwóch środkowych

return (sorted_nums[mid - 1] + sorted_nums[mid]) / 2

else:

# Jeśli nieparzysta, medianą jest środkowy element

return sorted_nums[mid]

ChatGPT zidentyfikował problem – brak obsługi przypadku parzystej liczby elementów – i zaproponował poprawione rozwiązanie. W nowej wersji funkcji sprawdzana jest długość listy (n); jeśli jest parzysta, funkcja zwraca średnią z dwóch środkowych wartości, w przeciwnym razie zwraca środkowy element. Taka poprawka czyni funkcję kompletną. Co ważne, model dodał nawet komentarze w kodzie, wyjaśniając swoje zmiany, co pomaga zrozumieć logikę.

Jak ulepszyć ten prompt? W kontekście debugowania, jeśli ChatGPT nie udzieli od razu satysfakcjonującej odpowiedzi, warto dodać więcej szczegółów. Na przykład, można było od razu podać przykład, dla którego kod źle działa: „np. median([1, 3, 7, 9]) zwraca 7 zamiast 5.0”. Takie informacje dodatkowo naprowadzają model na właściwy trop. W ogólności, przy problemach z kodem: podajmy fragmenty stosu błędu, komunikaty wyjątku, oczekiwany vs. aktualny wynik – im pełniejszy obraz sytuacji przekażemy, tym precyzyjniejsze będą sugestie ChatGPT.

Podobnie rzecz ma się z refaktoryzacją kodu. Jeżeli chcemy ulepszyć działający już kod, np. przyspieszyć go lub uczynić czytelniejszym, opiszmy to dokładnie. Zamiast: „Popraw ten kod”, lepiej napisać: „Popraw ten kod pod kątem czytelności i zastosuj dobre praktyki Pythona (PEP8). Unikaj zduplikowanego kodu i dodaj komentarze wyjaśniające trudniejsze fragmenty.”. Taka instrukcja sprawi, że ChatGPT wie, na co zwrócić uwagę przy refaktoryzacji (nazwy zmiennych, struktura, komentarze itp.). Warto też zaznaczyć, czy zależy nam na wydajności (np. „ten kod działa wolno dla dużych danych, czy możesz go zoptymalizować?”), czy na czymś innym. ChatGPT może zasugerować różne ulepszenia, ale to my musimy zdecydować, które z nich wdrożyć. Zawsze dobrze poprosić o wyjaśnienie powodów zmian, jakie AI proponuje – np. „Wyjaśnij, dlaczego zaproponowane zmiany poprawiają kod”. Wówczas oprócz nowego kodu dostaniemy opis, z którego można się sporo nauczyć.

Na koniec ważna uwaga: ChatGPT udziela sugestii, a nie gwarantowanych rozwiązań. Model bywa omylny i może czasem wygenerować kod, który zawiera błąd lub nie obsługuje jakiegoś przypadku brzegowego. Dlatego po zastosowaniu podpowiedzi z ChatGPT zawsze należy dokładnie przejrzeć i przetestować kod we własnym środowisku. W praktyce jednak, nawet jeśli odpowiedź nie jest perfekcyjna, często wskazuje właściwy kierunek lub inspiruje do rozwiązania problemu.

Podsumowanie

ChatGPT stał się potężnym narzędziem w arsenale programisty Python. Pozwala on na automatyzację nudnych czynności, przyspiesza pisanie kodu i pomaga rozwiązywać problemy, z którymi początkujący mogliby sobie nie poradzić samodzielnie. W tym artykule pokazaliśmy najlepsze prompty ChatGPT dla programistów Pythona – od prostych skryptów automatyzujących zadania, przez analizę danych i budowę modeli ML, po tworzenie API oraz debugowanie i poprawianie kodu. We wszystkich tych zastosowaniach kluczowe jest właściwe sformułowanie polecenia. Dobra praktyka to podawanie modelowi jak najwięcej kontekstu i jasnych wytycznych co do oczekiwanego wyniku. Gdy odpowiedź jest niepełna lub nie do końca trafiona, warto zadawać pytania uzupełniające – iteracyjna współpraca z ChatGPT często prowadzi do coraz lepszych rezultatów.

Pamiętajmy też, że choć ChatGPT potrafi generować imponujący kod, nie zastąpi myślenia i odpowiedzialności programisty. Traktujmy go raczej jako inteligentnego asystenta czy „sparring partnera” do kodu. Weryfikujmy sugestie, testujmy wygenerowane rozwiązania w realnym środowisku i nie bójmy się modyfikować kodu pod własne potrzeby. Taka symbioza wiedzy programisty i szybkości ChatGPT może znacznie zwiększyć produktywność – wielu developerów już teraz odczuwa, że AI stała się ich codziennym wsparciem w pracy.

Na koniec zachęcam do samodzielnych eksperymentów. Spróbuj wymyślić własne wyzwanie w Pythonie i opisz je ChatGPT jak najdokładniej. Być może zaskoczy Cię, jak trafne i użyteczne rozwiązanie otrzymasz. Udanej pracy z kodem i powodzenia w eksplorowaniu możliwości ChatGPT!