Ostatnia weryfikacja: 26 kwietnia 2026 r. Ten przewodnik pokazuje, jak używać ChatGPT i podobnych modeli AI w automatyzacji chmury oraz pracy DevOps: od CI/CD i Infrastructure as Code, przez analizę logów i incident response, po bezpieczeństwo, ChatOps, API i dobre praktyki governance.

Ważne rozróżnienie: ChatGPT to oficjalna usługa OpenAI. Czat GPT to niezależny polski serwis umożliwiający prostą rozmowę tekstową z asystentem AI po polsku. Czat GPT nie jest firmą OpenAI, nie jest oficjalną wersją ChatGPT i nie sprzedaje subskrypcji OpenAI. Ten artykuł opisuje zastosowania ChatGPT i modeli AI w DevOps ogólnie; nie oznacza to, że wszystkie funkcje oficjalnego ChatGPT, OpenAI API, Codex, model picker, Code Interpreter, Deep Research albo integracje firmowe są dostępne w Czat GPT.

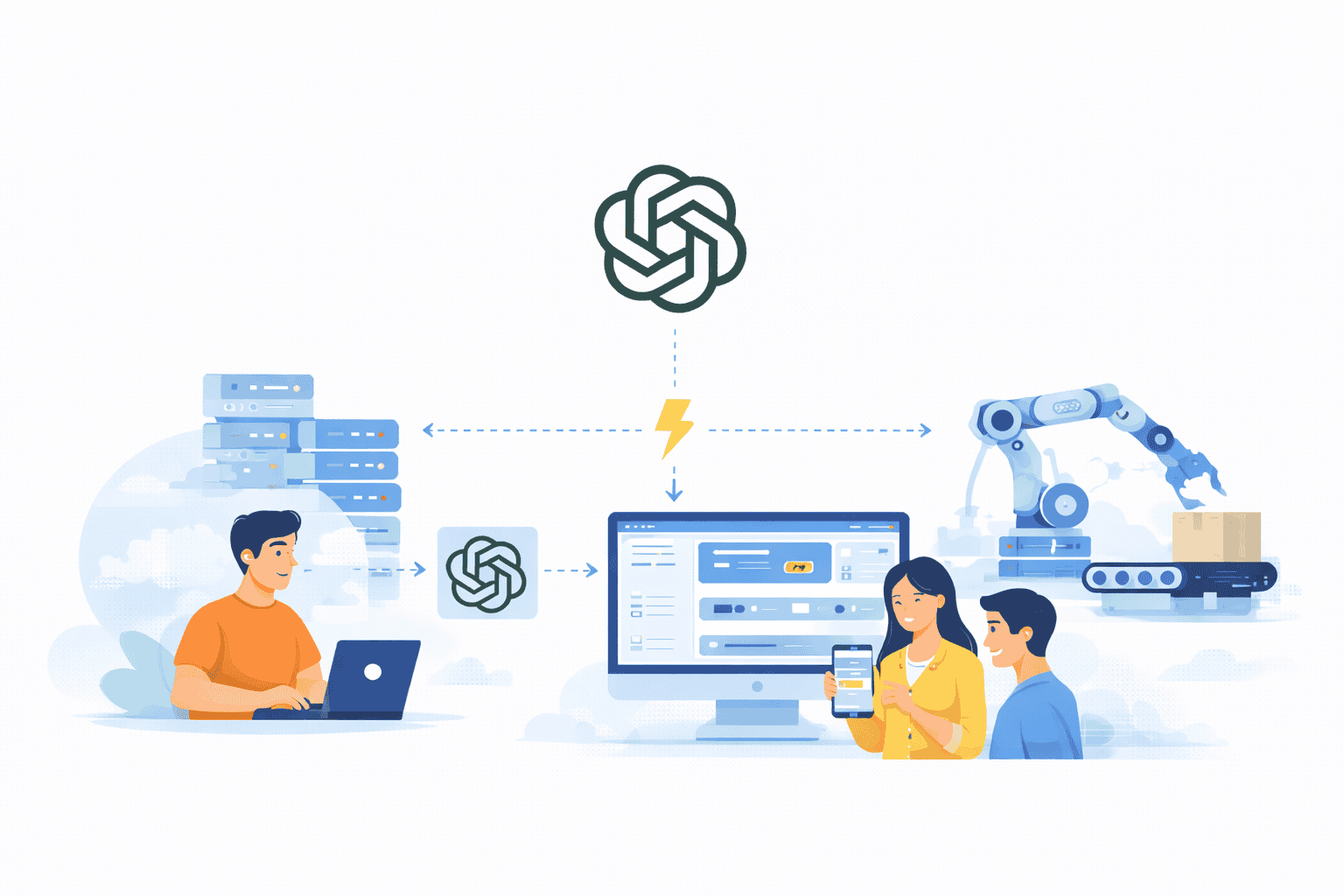

ChatGPT może pomagać zespołom DevOps w zadaniach językowych, analitycznych i programistycznych: wyjaśniać logi, pisać szkice pipeline’ów, streszczać incydenty, tworzyć dokumentację, generować zapytania monitoringowe, porządkować runbooki i przygotowywać pierwsze wersje konfiguracji. Najbezpieczniejsze podejście polega jednak na traktowaniu AI jako asystenta inżyniera, a nie autonomicznego operatora chmury.

Zasada przewodnia: AI może przyspieszać analizę, pisanie i porządkowanie pracy DevOps, ale nie powinno samodzielnie wdrażać zmian produkcyjnych, nadawać uprawnień, usuwać zasobów, restartować usług ani modyfikować infrastruktury bez kontroli człowieka i jasno zdefiniowanych reguł bezpieczeństwa.

Co ChatGPT może realnie robić w DevOps?

W praktyce ChatGPT najlepiej sprawdza się tam, gdzie trzeba szybko przejść od nieuporządkowanego tekstu do uporządkowanego działania: od logu do hipotezy, od opisu wymagań do szkicu YAML, od fragmentu dokumentacji do checklisty albo od notatek z incydentu do raportu post-mortem.

| Obszar DevOps | Jak może pomóc AI? | Co musi sprawdzić człowiek? |

|---|---|---|

| CI/CD | Tworzenie szkiców workflow, wyjaśnianie błędów builda, porządkowanie kroków deployu. | Uprawnienia, sekrety, kolejność deployu, rollback, środowiska i skutki kosztowe. |

| Infrastructure as Code | Generowanie pierwszych wersji Terraform, CloudFormation, Bicep lub Kubernetes YAML. | Plan zmian, least privilege, state, drift, polityki bezpieczeństwa i zgodność z architekturą. |

| Monitoring i observability | Streszczanie logów, proponowanie zapytań PromQL, CloudWatch Logs Insights lub KQL. | Czy zapytanie naprawdę mierzy właściwy sygnał i czy alert nie generuje szumu. |

| Incident response | Podsumowanie incydentu, hipotezy przyczyn, szkic post-mortem, lista działań naprawczych. | Root cause, wpływ na klientów, decyzje o rollbacku, komunikacja i priorytety. |

| Bezpieczeństwo | Wstępny przegląd polityk IAM, Dockerfile, manifestów Kubernetes i konfiguracji sieci. | Uprawnienia, sekrety, zgodność, ryzyko operacyjne i wynik skanerów bezpieczeństwa. |

| Koszty chmury | Analiza raportów kosztowych, szukanie anomalii, przygotowanie pytań do FinOps. | Dokładność danych, waluta, okres rozliczeniowy, rezerwacje, committed use i rabaty. |

| Dokumentacja | Tworzenie runbooków, README, instrukcji wdrożenia, checklist i podsumowań zmian. | Zgodność z faktycznym procesem, aktualność, odpowiedzialności i procedury awaryjne. |

Automatyzacja CI/CD z pomocą ChatGPT

Jednym z najczęstszych zastosowań ChatGPT w DevOps jest praca z pipeline’ami CI/CD. Model może wygenerować szkic workflow, wyjaśnić błąd z logu, zaproponować kolejność kroków, dodać komentarze do YAML albo pomóc przenieść pipeline między GitHub Actions, GitLab CI, Jenkins i Azure DevOps.

Trzeba jednak odróżnić szkic wygenerowany przez AI od konfiguracji gotowej do produkcji. Pipeline może mieć wpływ na produkcyjne wdrożenia, koszty, sekrety, artefakty i dostęp do zasobów chmurowych. Dlatego każdy plik wygenerowany przez AI powinien przejść code review, test na środowisku staging oraz walidację uprawnień.

Prompt do wygenerowania pipeline CI/CD

Przygotuj szkic GitHub Actions dla aplikacji Node.js.

Wymagania:

- uruchom workflow przy pull request oraz push do main,

- użyj actions/checkout@v4,

- użyj actions/setup-node@v4,

- użyj npm ci, npm test i npm run build,

- deployment do AWS S3 tylko przy push do main,

- nie używaj długoterminowych AWS access keys,

- użyj OIDC i aws-actions/configure-aws-credentials,

- dodaj komentarze, gdzie trzeba skonfigurować IAM role i bucket.

Nie zakładaj, że plik jest gotowy do produkcji. Dodaj checklistę weryfikacji.Przykładowy workflow GitHub Actions z OIDC do AWS

Poniższy przykład jest bezpieczniejszy niż konfiguracje oparte na stałych sekretach AWS_ACCESS_KEY_ID i AWS_SECRET_ACCESS_KEY. Wykorzystuje OIDC, czyli krótkotrwałe credentials uzyskiwane przez workflow po założeniu odpowiedniej roli IAM w AWS.

name: Build and deploy static Node app

on:

pull_request:

branches: ["main"]

push:

branches: ["main"]

permissions:

contents: read

id-token: write

jobs:

build:

name: Build and test

runs-on: ubuntu-latest

steps:

- name: Checkout repository

uses: actions/checkout@v4

- name: Set up Node.js

uses: actions/setup-node@v4

with:

node-version: "22"

cache: "npm"

- name: Install dependencies

run: npm ci

- name: Run tests

run: npm test

- name: Build project

run: npm run build

- name: Upload build artifact

uses: actions/upload-artifact@v4

with:

name: web-build

path: dist/

deploy:

name: Deploy to S3

runs-on: ubuntu-latest

needs: build

if: github.event_name == 'push' && github.ref == 'refs/heads/main'

steps:

- name: Download build artifact

uses: actions/download-artifact@v4

with:

name: web-build

path: dist/

- name: Configure AWS credentials via OIDC

uses: aws-actions/configure-aws-credentials@v4

with:

role-to-assume: arn:aws:iam::123456789012:role/github-actions-deploy-role

aws-region: eu-central-1

- name: Sync files to S3

run: |

aws s3 sync dist/ s3://example-static-site-bucket/ --deletePrzed użyciem: skonfiguruj zaufanie OIDC między GitHub Actions i AWS, ogranicz rolę IAM do konkretnego repozytorium, branchy i zasobów, przetestuj pipeline na stagingu oraz sprawdź, czy deployment nie usuwa potrzebnych plików przez --delete.

Prompt do analizy błędu CI/CD

Przeanalizuj poniższy log z pipeline CI/CD.

Zwróć:

1. Prawdopodobną przyczynę błędu.

2. Najbardziej prawdopodobny plik lub etap, którego dotyczy problem.

3. Kroki diagnostyczne.

4. Bezpieczną propozycję poprawki.

5. Informację, czego nie da się stwierdzić z samego logu.

Nie wymyślaj danych, których nie ma w logu.

Log:

[WKLEJ FRAGMENT LOGU]Infrastructure as Code i provisioning z AI

ChatGPT może pomóc przy pracy z Terraform, CloudFormation, Bicep, Kubernetes YAML i innymi formatami Infrastructure as Code. Najlepiej traktować go jako asystenta do przygotowania pierwszej wersji konfiguracji, wyjaśniania istniejącego kodu i tworzenia checklist review.

AI nie powinno zastępować takich kroków jak terraform fmt, terraform validate, terraform plan, review przez drugiego inżyniera, skanowanie IaC oraz polityki organizacyjne. Każda zmiana infrastruktury może mieć skutki produkcyjne, finansowe lub bezpieczeństwa.

Prompt do review Terraform

Przejrzyj poniższy kod Terraform jako asystent DevOps.

Sprawdź:

- czy zasoby są opisane jasno,

- czy nie ma nadmiernie szerokich uprawnień,

- czy nie ma sekretów w kodzie,

- czy zasoby mają tagi,

- czy konfiguracja wymaga dodatkowych walidacji,

- czy trzeba uruchomić terraform validate / plan,

- jakie ryzyka trzeba sprawdzić ręcznie.

Nie zakładaj, że kod jest bezpieczny. Zwróć listę uwag i propozycje poprawek.

Kod:

[WKLEJ KOD TERRAFORM]Przykład bezpieczniejszego szkicu Terraform: prywatny bucket S3

W starszych przykładach AI często generuje konfiguracje z publicznym dostępem, otwartym SSH albo zbyt szerokimi regułami. Poniższy przykład pokazuje ostrożniejszy wzorzec: bucket jest prywatny, blokuje publiczny dostęp i ma włączone szyfrowanie po stronie S3.

terraform {

required_version = ">= 1.6.0"

required_providers {

aws = {

source = "hashicorp/aws"

version = "~> 5.0"

}

}

}

variable "bucket_name" {

description = "Unique S3 bucket name for private application artifacts."

type = string

validation {

condition = length(var.bucket_name) >= 3

error_message = "Bucket name must contain at least 3 characters."

}

}

variable "environment" {

description = "Deployment environment, for example dev, staging or prod."

type = string

default = "staging"

}

resource "aws_s3_bucket" "artifacts" {

bucket = var.bucket_name

tags = {

Environment = var.environment

ManagedBy = "terraform"

Purpose = "private-artifacts"

}

}

resource "aws_s3_bucket_public_access_block" "artifacts" {

bucket = aws_s3_bucket.artifacts.id

block_public_acls = true

block_public_policy = true

ignore_public_acls = true

restrict_public_buckets = true

}

resource "aws_s3_bucket_server_side_encryption_configuration" "artifacts" {

bucket = aws_s3_bucket.artifacts.id

rule {

apply_server_side_encryption_by_default {

sse_algorithm = "AES256"

}

}

}Ten kod nadal wymaga review. Przed użyciem w produkcji trzeba sprawdzić backend state, wersje providerów, polityki dostępu, nazewnictwo, region, lifecycle rules, logging, ewentualne KMS oraz zgodność z polityką organizacji.

Monitoring, logi i obserwowalność

AI może pomóc w analizie logów, ale nie zastępuje systemów obserwowalności takich jak CloudWatch, Azure Monitor, Google Cloud Logging, Prometheus, Grafana, Datadog, Splunk czy OpenTelemetry. Najlepszy wzorzec to: narzędzie monitoringu zbiera dane, a AI pomaga je streścić, wyjaśnić i zamienić w hipotezy diagnostyczne.

W praktyce ChatGPT może pomóc przy:

- streszczaniu długich logów aplikacyjnych,

- wyjaśnianiu stack trace,

- tworzeniu pierwszych wersji zapytań PromQL, KQL, SQL lub CloudWatch Logs Insights,

- porównywaniu alertów z ostatnimi deploymentami,

- tworzeniu notatek dla zespołu on-call,

- pisaniu runbooków dla powtarzalnych problemów.

Prompt do analizy logu

Przeanalizuj poniższy fragment logu jako asystent SRE.

Zwróć:

1. Krótkie streszczenie problemu.

2. Najbardziej prawdopodobne hipotezy.

3. Dane, których brakuje do potwierdzenia przyczyny.

4. Bezpieczne kroki diagnostyczne.

5. Czego nie należy robić automatycznie bez zgody inżyniera.

Log:

[WKLEJ LOG]Prompt do wygenerowania zapytania PromQL

Napisz propozycję zapytania PromQL.

Cel:

- alert, gdy użycie pamięci kontenera przekracza 90% przez ponad 5 minut,

- wynik powinien być możliwy do użycia jako punkt startowy dla alertu,

- wyjaśnij ograniczenia zapytania,

- nie zakładaj nazw metryk, jeśli ich nie podałem; zaproponuj warianty.

Kontekst:

[OPIS SYSTEMU I DOSTĘPNE METRYKI]Ważne: AI może zaproponować składnię, ale inżynier musi sprawdzić realne nazwy metryk, labeli, cardinality, okna czasowe, progi i wpływ alertu na liczbę powiadomień.

Incident response i post-mortem

Podczas incydentu najważniejsze są czas, spokój i poprawna komunikacja. ChatGPT może zmniejszyć obciążenie poznawcze zespołu, przygotowując podsumowanie osi czasu, listę hipotez, pytania diagnostyczne lub szkic raportu post-mortem. Nie powinien jednak samodzielnie decydować o rollbacku, zmianie ruchu, wyłączeniu zasobów lub modyfikacji konfiguracji produkcyjnej.

Prompt do triage incydentu

Pomóż przygotować triage incydentu.

Dane:

- opis alertu,

- ostatnie deploymenty,

- wybrane logi,

- metryki,

- wpływ na użytkowników,

- działania wykonane do tej pory.

Zwróć:

1. Krótkie streszczenie sytuacji.

2. Oś czasu.

3. Hipotezy przyczyn.

4. Brakujące dane.

5. Bezpieczne kroki diagnostyczne.

6. Kroki, które wymagają zatwierdzenia człowieka.

7. Propozycję komunikatu dla kanału incidentowego.

Nie przedstawiaj hipotez jako faktów.Szablon post-mortem z pomocą AI

Na podstawie poniższych danych przygotuj szkic post-mortem.

Sekcje:

- Podsumowanie incydentu.

- Wpływ na użytkowników.

- Oś czasu.

- Przyczyna źródłowa, jeśli została potwierdzona.

- Co zadziałało dobrze.

- Co zadziałało źle.

- Działania naprawcze.

- Właściciel każdego działania.

- Termin realizacji.

- Pytania otwarte.

Ważne:

- Oddziel fakty od hipotez.

- Nie obwiniaj osób.

- Nie dopisuj danych, których nie ma w materiale.

Materiał:

[WKLEJ LOGI, TIMELINE I NOTATKI]Bezpieczeństwo, IAM i DevSecOps

W DevOps największe ryzyko nie polega na tym, że AI napisze nieładny YAML. Ryzyko polega na tym, że wygeneruje zbyt szerokie uprawnienia, otwarte porty, publiczny bucket, sekret w kodzie albo komendę, która usunie zasób produkcyjny. Dlatego przy pracy z AI w DevSecOps trzeba stosować zasadę najmniejszych uprawnień i kontrolę człowieka.

Czego nie wklejać do AI?

- kluczy API, tokenów, haseł i prywatnych kluczy SSH,

- sekretów z Kubernetes, Terraform state lub plików

.env, - danych klientów, danych płatniczych i danych medycznych,

- pełnych konfiguracji zawierających poufne identyfikatory,

- niezamaskowanych logów z danymi osobowymi,

- wewnętrznych dokumentów objętych tajemnicą firmy, jeśli polityka organizacji tego zabrania.

Prompt do przeglądu polityki IAM

Przejrzyj poniższą politykę IAM jako wstępny reviewer bezpieczeństwa.

Sprawdź:

- czy uprawnienia są zgodne z zasadą least privilege,

- czy są akcje wildcard,

- czy są zasoby wildcard,

- czy można zawęzić Resource, Condition lub principal,

- czy polityka może spowodować eskalację uprawnień,

- jakie pytania powinien zadać security reviewer.

Nie zatwierdzaj polityki. Zwróć ryzyka i propozycje zawężenia.

Polityka:

[WKLEJ POLITYKĘ BEZ SEKRETÓW]AI może pomóc w zrozumieniu polityki, ale finalna decyzja powinna należeć do osoby odpowiedzialnej za bezpieczeństwo lub platform engineering. Warto łączyć AI z klasycznymi narzędziami: skanerami IaC, analizą uprawnień, testami, policy-as-code i review przez drugiego inżyniera.

ChatOps i integracje przez API

Zaawansowane użycie AI w DevOps często polega na integracji modelu z narzędziami: Slack, Microsoft Teams, GitHub, Jira, GitLab, Jenkins, Kubernetes, AWS, Azure, Google Cloud albo systemem logów. W takim scenariuszu model nie powinien „zgadywać” wyniku operacji. Powinien poprosić aplikację o wywołanie konkretnego narzędzia, a aplikacja powinna wykonać to narzędzie z ograniczonymi uprawnieniami.

W OpenAI API wzorzec tool/function calling działa jako wieloetapowy przepływ: aplikacja daje modelowi listę dostępnych narzędzi, model może poprosić o wywołanie narzędzia, aplikacja wykonuje funkcję po swojej stronie, a następnie wynik wraca do modelu jako kontekst do finalnej odpowiedzi.

Bezpieczny wzorzec ChatOps

| Krok | Co robi AI? | Co robi aplikacja? |

|---|---|---|

| 1. Polecenie | Rozumie intencję użytkownika, np. „pokaż błędy payment-api”. | Sprawdza tożsamość użytkownika i jego uprawnienia. |

| 2. Decyzja o narzędziu | Proponuje użycie funkcji, np. get_recent_errors(service). | Waliduje parametry i zakres dostępu. |

| 3. Wykonanie | Nie wykonuje komendy samodzielnie. | Wywołuje bezpieczną funkcję z ograniczonymi uprawnieniami. |

| 4. Odpowiedź | Streszcza wynik i proponuje następne kroki. | Loguje operację i wymaga zatwierdzenia przy działaniach ryzykownych. |

Przykładowy prompt systemowy dla bota ChatOps

Jesteś asystentem DevOps w kanale ChatOps.

Zasady:

- możesz pomagać w analizie logów, metryk i dokumentacji,

- nie wykonuj działań destrukcyjnych,

- nie restartuj usług, nie skaluj produkcji i nie uruchamiaj deploymentu bez potwierdzenia człowieka,

- nie proś użytkownika o sekrety ani tokeny,

- jeśli potrzebujesz danych, poproś aplikację o użycie właściwego narzędzia,

- oddziel fakty z narzędzia od hipotez,

- przy ryzyku produkcyjnym poproś o zatwierdzenie inżyniera on-call.Przykład integracji OpenAI API do streszczania logów

Poniższy przykład pokazuje prosty wzorzec: aplikacja pobiera lub otrzymuje fragment logu, maskuje dane wrażliwe, a następnie prosi model o podsumowanie. Przykład używa Responses API i klucza z czytanej przez SDK zmiennej środowiskowej OPENAI_API_KEY.

import os

from openai import OpenAI

client = OpenAI()

MODEL = os.getenv("OPENAI_MODEL", "gpt-5.5")

log_text = """

[2026-04-26 10:14:02] ERROR payment-api connection refused 10.0.3.4:5432

[2026-04-26 10:14:05] ERROR payment-api retry failed after 3 attempts

[2026-04-26 10:14:08] WARN payment-api circuit breaker opened

"""

response = client.responses.create(

model=MODEL,

store=False,

input=[

{

"role": "system",

"content": (

"You are a DevOps assistant. Summarize logs, separate facts "

"from hypotheses, and never recommend destructive actions "

"without human approval."

)

},

{

"role": "user",

"content": (

"Analyze this log excerpt. Return: summary, possible causes, "

"safe diagnostic steps, and what requires human approval.\n\n"

f"{log_text}"

)

}

]

)

print(response.output_text)Przed wdrożeniem produkcyjnym: sprawdź aktualną dokumentację OpenAI, wybierz model zgodny z wymaganiami, maskuj dane osobowe i sekrety, dodaj limity kosztów, obsługę błędów, retry/backoff, monitoring użycia tokenów i politykę retencji danych.

Code Interpreter i analiza danych DevOps

Code Interpreter w OpenAI API pozwala modelom pisać i uruchamiać kod Python w sandboxowym środowisku. W DevOps może to być przydatne przy analizie plików CSV z kosztami, logów w formacie tabelarycznym, raportów wydajności, zestawów metryk lub wyników testów obciążeniowych.

Nie należy jednak traktować go jako zamiennika systemów produkcyjnego monitoringu. To narzędzie do analizy, eksploracji i przygotowania wniosków. Przykłady dobrego użycia:

- analiza raportu kosztów chmury i wskazanie największych kategorii wydatków,

- porównanie wyników testu obciążeniowego przed i po zmianie,

- wykrycie anomalii w tabeli czasów odpowiedzi,

- utworzenie wykresu trendu błędów z pliku CSV,

- przygotowanie podsumowania danych do raportu SRE.

Prompt do analizy kosztów chmury

Przeanalizuj załączony raport kosztów chmury.

Zwróć:

1. Top 10 usług według kosztu.

2. Największe zmiany miesiąc do miesiąca.

3. Potencjalne anomalie.

4. Pytania, które trzeba zadać zespołowi FinOps.

5. Sugestie optymalizacji, ale bez obiecywania konkretnych oszczędności.

Nie wyciągaj wniosków, jeśli danych brakuje.AI-native narzędzia chmurowe: AWS, Google Cloud i Azure

ChatGPT nie jest jedynym sposobem użycia AI w DevOps. Dostawcy chmury rozwijają własne asystenty i narzędzia AI. Warto znać je jako kontekst, bo czasem są lepszym wyborem niż ogólny model językowy, szczególnie gdy mają bezpośredni dostęp do dokumentacji, usług i zasobów danej chmury.

| Dostawca | Przykład narzędzia | Do czego służy? |

|---|---|---|

| AWS | Amazon Q Developer, Amazon DevOps Guru | Pomoc w budowaniu, zrozumieniu i operowaniu aplikacjami AWS; DevOps Guru używa ML do wykrywania nietypowych wzorców operacyjnych i rekomendacji. |

| Google Cloud | Gemini Cloud Assist | Wsparcie w troubleshooting, analizie logów, wydajności, baz danych, SQL, aplikacji i eskalacji do supportu. |

| Azure | GitHub Copilot for Azure | Pomoc w nauce, projektowaniu, deployu i troubleshootingu usług Azure przez narzędzia dostępne m.in. w IDE. |

Najważniejsza różnica: narzędzia chmurowe mogą być mocniej zintegrowane z danym środowiskiem, ale nadal wymagają kontroli człowieka. Microsoft wprost zaleca przeglądanie odpowiedzi AI, walidację kosztów i skutków bezpieczeństwa oraz niewklejanie sekretów do promptów. To dobra zasada dla każdego narzędzia AI w DevOps.

Prywatność, dane i governance

DevOps często pracuje na danych, które mogą zawierać sekrety, adresy IP, identyfikatory klientów, tokeny, nazwy usług wewnętrznych, fragmenty kodu i dane finansowe. Dlatego wdrożenie AI wymaga zasad governance.

W przypadku OpenAI API aktualna dokumentacja OpenAI wskazuje, że dane przesyłane do API nie są używane do trenowania lub ulepszania modeli, chyba że organizacja wyraźnie zdecyduje się na udostępnianie danych. Nadal jednak mogą istnieć logi monitoringu nadużyć lub stan aplikacji potrzebny do działania wybranych funkcji. Przed wdrożeniem firmowym trzeba sprawdzić aktualne warunki, ustawienia retencji, DPA, wymagania prawne i politykę własnej organizacji.

W przypadku Czat GPT należy czytać zasady opisane w Polityce prywatności, Bezpieczeństwie i Regulaminie. Serwis nie powinien być traktowany jako prywatna konsola DevOps do wklejania sekretów, logów produkcyjnych lub poufnej dokumentacji.

Minimalny standard governance dla AI w DevOps

- Ustal, które dane można wysyłać do AI, a których nie wolno.

- Maskuj sekrety, tokeny, hasła i dane klientów przed analizą.

- Rozdziel środowiska: eksperyment, staging, produkcja.

- Wymagaj zatwierdzenia człowieka dla zmian produkcyjnych.

- Loguj użycie narzędzi AI w procesach operacyjnych.

- Ustal właściciela promptów systemowych i runbooków.

- Monitoruj koszty, tokeny, opóźnienia i jakość odpowiedzi.

- Testuj odpowiedzi AI na realnych, ale zanonimizowanych przypadkach.

- Nie zastępuj skanerów bezpieczeństwa samym ChatGPT.

- Regularnie aktualizuj linki do oficjalnych dokumentów i cenników.

Jak wdrożyć AI w DevOps krok po kroku?

- Wybierz mały przypadek użycia. Zacznij od bezpiecznego zadania: streszczanie logów, generowanie runbooków albo wyjaśnianie błędów CI.

- Zdefiniuj granice. Określ, czego AI nie może robić: deploy produkcji, usuwanie zasobów, zmiana IAM, restart usług, obsługa sekretów.

- Przygotuj dane wejściowe. Maskuj wrażliwe informacje i ogranicz kontekst do tego, co potrzebne.

- Stwórz bibliotekę promptów. Osobne prompty dla CI/CD, IaC, logów, incident response, IAM i kosztów.

- Testuj na historycznych przypadkach. Sprawdź, czy AI daje użyteczne hipotezy i nie sugeruje ryzykownych działań.

- Włącz human-in-the-loop. Każda zmiana produkcyjna wymaga zatwierdzenia inżyniera.

- Mierz jakość. Obserwuj czas analizy, liczbę korekt, błędy, eskalacje, koszty i feedback zespołu.

- Rozszerzaj ostrożnie. Dopiero po bezpiecznych wynikach przechodź do ChatOps i integracji z narzędziami.

Biblioteka promptów dla DevOps

1. Wyjaśnienie błędu builda

Wyjaśnij błąd z pipeline CI/CD.

Zwróć:

- krótkie streszczenie,

- możliwą przyczynę,

- 3 kroki diagnostyczne,

- propozycję poprawki,

- ryzyka i założenia.

Log:

[WKLEJ LOG]2. Review Kubernetes manifest

Przejrzyj manifest Kubernetes.

Sprawdź:

- resources requests/limits,

- readiness/liveness probes,

- image tag,

- securityContext,

- sekrety,

- namespace,

- ryzyka związane z dostępem sieciowym.

Nie zatwierdzaj manifestu. Zwróć listę problemów i poprawek.

Manifest:

[WKLEJ YAML]3. Runbook dla alertu

Napisz runbook dla alertu.

Alert:

[OPIS ALERTU]

Runbook ma zawierać:

1. Co oznacza alert.

2. Jakie dane sprawdzić.

3. Bezpieczne komendy diagnostyczne.

4. Typowe przyczyny.

5. Kiedy eskalować.

6. Czego nie robić automatycznie.

7. Linki do dokumentacji wewnętrznej jako placeholdery.4. Analiza kosztów chmury

Przeanalizuj poniższe dane kosztowe.

Zwróć:

- największe kategorie kosztów,

- potencjalne anomalie,

- pytania do właścicieli usług,

- działania do sprawdzenia,

- ryzyka błędnej interpretacji.

Dane:

[WKLEJ TABELĘ LUB CSV BEZ DANYCH WRAŻLIWYCH]5. Post-mortem bez obwiniania

Przygotuj szkic post-mortem w stylu blameless.

Dane:

[WKLEJ OŚ CZASU, LOGI I NOTATKI]

Sekcje:

- podsumowanie,

- wpływ,

- timeline,

- root cause potwierdzony / niepotwierdzony,

- działania naprawcze,

- właściciele,

- terminy,

- pytania otwarte.

Nie obwiniaj osób. Oddziel fakty od hipotez.Najczęstsze błędy przy użyciu ChatGPT w DevOps

- Wklejanie sekretów: tokeny, hasła i klucze API nigdy nie powinny trafiać do promptów.

- Automatyczne wykonywanie komend: AI nie powinno bez zatwierdzenia uruchamiać działań zmieniających produkcję.

- Brak review kodu IaC: YAML lub Terraform z AI trzeba traktować jak kod juniora, który wymaga sprawdzenia.

- Zaufanie do fałszywej pewności: model może brzmieć przekonująco, ale nadal się mylić.

- Mylenie ChatGPT, API, Codex i Czat GPT: to różne konteksty użycia, różne funkcje i różne zasady.

- Brak pomiaru kosztów: długie logi i duże konteksty mogą generować realne koszty API.

- Nieaktualne linki i modele: nazwy modeli, ceny i limity mogą się zmieniać, więc linkuj do oficjalnych źródeł.

- Brak procedury eskalacji: system musi wiedzieć, kiedy oddać sprawę człowiekowi.

Jak ta strona wspiera Czat GPT po polsku?

Ta strona jest częścią sekcji Przewodniki i pokazuje praktyczne zastosowanie AI w konkretnym obszarze: DevOps i automatyzacji chmury. Jej zadaniem nie jest udawanie oficjalnej dokumentacji OpenAI, AWS, Google Cloud, Microsoft ani GitHub. To niezależny przewodnik edukacyjny dla użytkowników, którzy chcą lepiej rozumieć, jak AI może pomagać w pracy technicznej.

Najważniejszy przekaz dla użytkownika jest prosty: AI po polsku może pomagać w pisaniu, wyjaśnianiu, streszczaniu i planowaniu pracy technicznej, ale nie zastępuje inżyniera DevOps, security review ani oficjalnej dokumentacji. Jeśli chcesz przetestować prostą rozmowę z asystentem AI po polsku, przejdź na stronę główną Czat GPT. Jeśli potrzebujesz oficjalnych funkcji OpenAI dla firm lub API, sprawdź bezpośrednio dokumentację OpenAI.

Oficjalne źródła i dokumenty do sprawdzenia

| Źródło | Dlaczego warto je sprawdzić? |

|---|---|

| ChatGPT Capabilities Overview – OpenAI Help Center | Oficjalny opis podstawowych możliwości ChatGPT, takich jak pisanie, streszczanie, tłumaczenie i rozumowanie. |

| OpenAI API Quickstart | Aktualny punkt startowy dla deweloperów korzystających z OpenAI API i SDK. |

| Function calling – OpenAI API | Wyjaśnia, jak model może prosić aplikację o wywołanie funkcji lub narzędzia. |

| Code Interpreter – OpenAI API | Opisuje uruchamianie kodu Python w sandboxie do analizy danych, kodowania i matematyki. |

| Data controls in the OpenAI platform | Opisuje, jak OpenAI traktuje dane przesyłane do API i jakie dane mogą być przechowywane. |

| GitHub Actions Workflow Syntax | Oficjalna dokumentacja składni workflow GitHub Actions. |

| GitHub Actions OIDC with AWS | Opisuje dostęp do AWS z GitHub Actions bez długoterminowych sekretów AWS. |

| AWS IAM best practices | Oficjalne praktyki AWS dotyczące MFA, temporary credentials i least privilege. |

| Terraform validation – HashiCorp | Opisuje walidacje, preconditions, postconditions i check blocks w Terraform. |

| Amazon Q Developer – AWS | Oficjalny opis asystenta AWS do budowania, rozumienia i operowania aplikacjami AWS. |

| Amazon DevOps Guru – AWS | Opisuje użycie machine learning do wykrywania nietypowych wzorców operacyjnych i rekomendacji. |

| Gemini Cloud Assist – Google Cloud | Oficjalny opis pomocy AI w troubleshooting, logach, bazach danych i operacjach chmurowych. |

| GitHub Copilot for Azure – Microsoft Learn | Opisuje użycie Copilot for Azure do nauki, projektowania, deployu i troubleshootingu usług Azure. |

| Polityka prywatności Czat GPT | Wyjaśnia zasady przetwarzania danych w niezależnym serwisie Czat GPT. |

| Bezpieczeństwo Czat GPT | Przypomina, aby nie wpisywać danych poufnych, haseł, tokenów ani informacji wrażliwych. |

| FAQ Czat GPT | Wyjaśnia, czym Czat GPT różni się od oficjalnego ChatGPT. |

Podsumowanie

ChatGPT w automatyzacji chmury najlepiej działa jako asystent DevOps: pomaga pisać szkice, wyjaśniać błędy, streszczać logi, tworzyć runbooki, analizować incydenty i przygotowywać dokumentację. Największą wartość daje tam, gdzie inżynier musi szybko uporządkować dużo informacji i zamienić je w plan działania.

Najważniejsze ograniczenie jest równie proste: AI nie powinno samodzielnie wykonywać ryzykownych operacji na produkcji. Pipeline, Terraform, IAM, Kubernetes, alerty i incident response wymagają review, testów, zatwierdzeń i monitoringu. Dobre wdrożenie AI w DevOps łączy szybkość modelu z odpowiedzialnością człowieka.

Jeżeli chcesz po prostu rozpocząć rozmowę z AI po polsku, możesz skorzystać z Czat GPT po polsku. Jeżeli budujesz firmową automatyzację DevOps, ChatOps albo integrację z API, sprawdź oficjalną dokumentację OpenAI, AWS, Google Cloud, Microsoft, GitHub i narzędzi, których używasz w swojej organizacji.

FAQ

Czy ChatGPT może automatyzować DevOps?

Tak, ChatGPT może pomagać w automatyzacji DevOps, szczególnie przy pisaniu szkiców pipeline, analizie logów, dokumentacji, runbookach, post-mortem, promptach i wyjaśnianiu błędów. Nie powinien jednak samodzielnie wykonywać zmian produkcyjnych bez kontroli człowieka.

Czy AI może wygenerować gotowy pipeline CI/CD?

AI może wygenerować użyteczny szkic pipeline CI/CD, ale nie należy traktować go jako gotowego do produkcji bez review. Trzeba sprawdzić sekrety, uprawnienia, środowiska, rollback, branch protection, cache, artefakty i skutki kosztowe.

Czy można wklejać logi produkcyjne do ChatGPT?

Można analizować logi z pomocą AI tylko po ocenie ryzyka i najlepiej po zamaskowaniu danych wrażliwych. Nie należy wklejać tokenów, haseł, kluczy API, danych klientów, dokumentów tożsamości ani informacji poufnych.

Czy ChatGPT może pisać Terraform?

Tak, ChatGPT może przygotować szkic Terraform i pomóc wyjaśnić istniejącą konfigurację. Każdy kod IaC trzeba jednak sprawdzić przez terraform fmt, terraform validate, terraform plan, review bezpieczeństwa i zasady organizacyjne przed wdrożeniem.

Czy AI może sama restartować usługi lub robić rollback?

W bezpiecznym wdrożeniu AI nie powinna samodzielnie restartować usług, robić rollbacku, skalować produkcji ani usuwać zasobów. Może zaproponować działania i przygotować komendy, ale operacje ryzykowne powinien zatwierdzić inżynier.

Czy OpenAI API i ChatGPT to to samo?

Nie. ChatGPT to aplikacja dla użytkowników, a OpenAI API to osobna usługa dla deweloperów i firm. Mają inne zasady dostępu, rozliczeń, integracji, limitów i konfiguracji danych.

Czy Czat GPT jest oficjalnym ChatGPT?

Nie. Czat GPT to niezależny polski serwis umożliwiający rozmowę z asystentem AI po polsku. Nie jest firmą OpenAI ani oficjalną wersją ChatGPT. Nazwy ChatGPT, OpenAI i GPT są używane informacyjnie.

Czy Czat GPT oferuje pełne funkcje DevOps OpenAI?

Nie należy tego zakładać. Czat GPT służy do prostej rozmowy tekstowej po polsku. Oficjalne funkcje OpenAI, takie jak API, Code Interpreter, Codex, model picker, narzędzia firmowe i integracje, zależą od oficjalnych produktów i planów OpenAI.

Jak zacząć używać AI w DevOps bezpiecznie?

Najlepiej zacząć od małego i bezpiecznego przypadku użycia: streszczania logów, pisania runbooków albo wyjaśniania błędów CI. Następnie warto dodać reguły governance, maskowanie danych, review człowieka i monitoring jakości odpowiedzi.

Czy AI zastąpi inżynierów DevOps?

Nie. AI może odciążyć inżynierów od części pracy tekstowej, dokumentacyjnej i analitycznej, ale nadal potrzebni są ludzie do projektowania architektury, oceny ryzyka, decyzji produkcyjnych, bezpieczeństwa i odpowiedzialności za system.